出售本站【域名】【外链】

本创 Simon_阿文 果壳

不少人说今年是“AI 绘画元年”。先是 Disco Diffusion 火出了圈,从 TeVt-to-Image(用笔朱生成图像)开发社区和创意设想止业,火到了普通人的室野中。

人们热衷将两种彻底不搭界的对象,比如“达芬奇”和“iPhone”字样,输入 AI 步调,而后等着画面层层衬着完成。

又比如,我就把钱袋蛋揉进了云朵里丨做者用 Disco Diffusion 生成

这是一种“装盲盒”般的体验。应付没有任何美术根原和绘画才华的人来说,AI 的“融梗”图大多足够惊燕,即便成效“翻车”,也能通过调解形容词继续劣化。

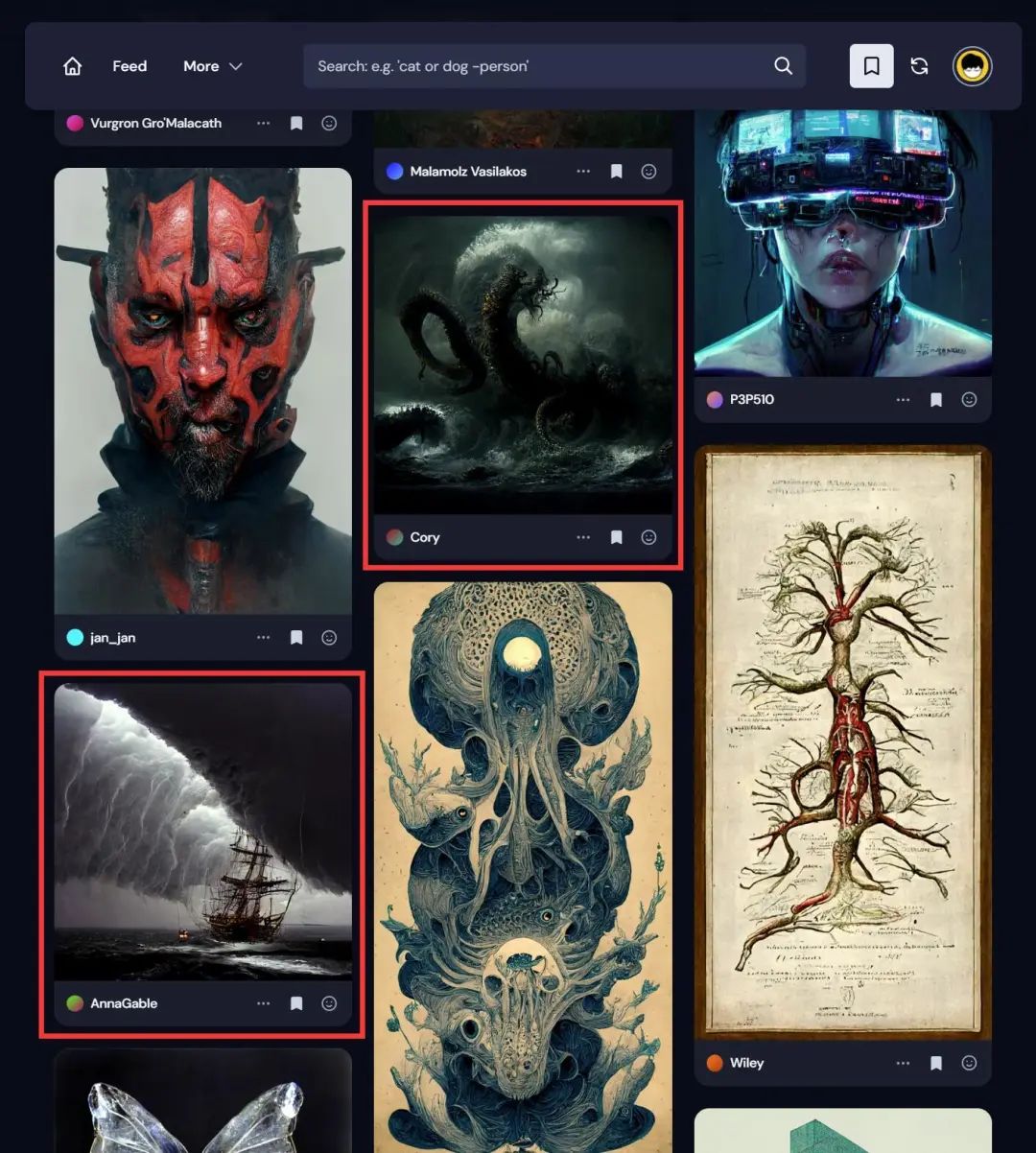

紧接着,AI 绘画工具 Midjourney 也火了。和 Disco Diffusion 满屏英文和代码的粗陋界面差异,Midjourney 间接搭载正在 Discord 频道上,输入指令的历程和给人发微信没什么差异,更让人受惊的是,它生成画做的光阳正常正在 60 秒摆布。

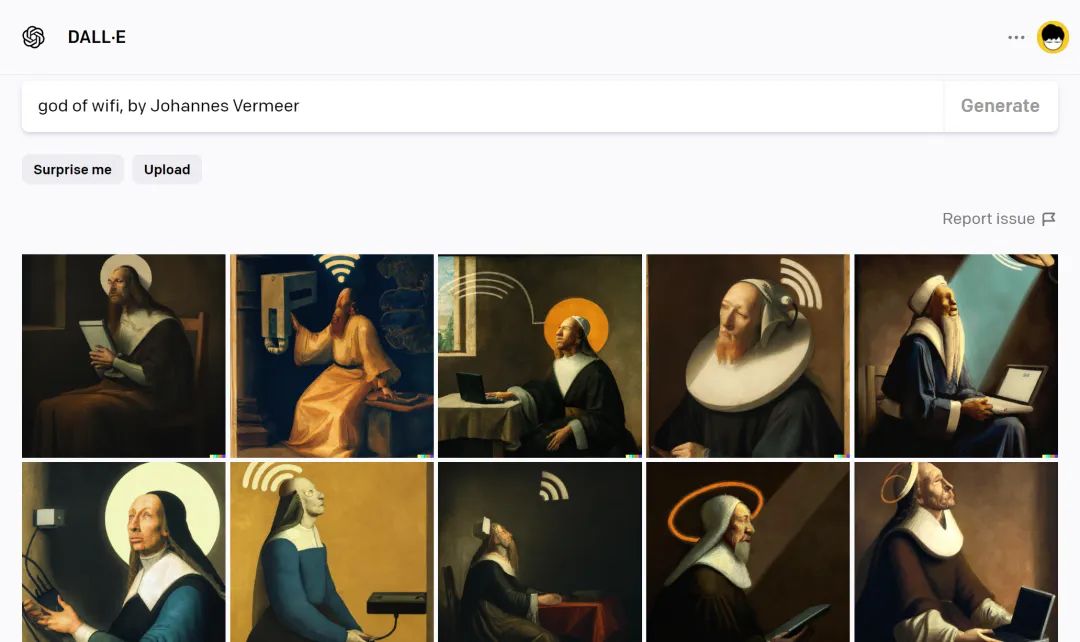

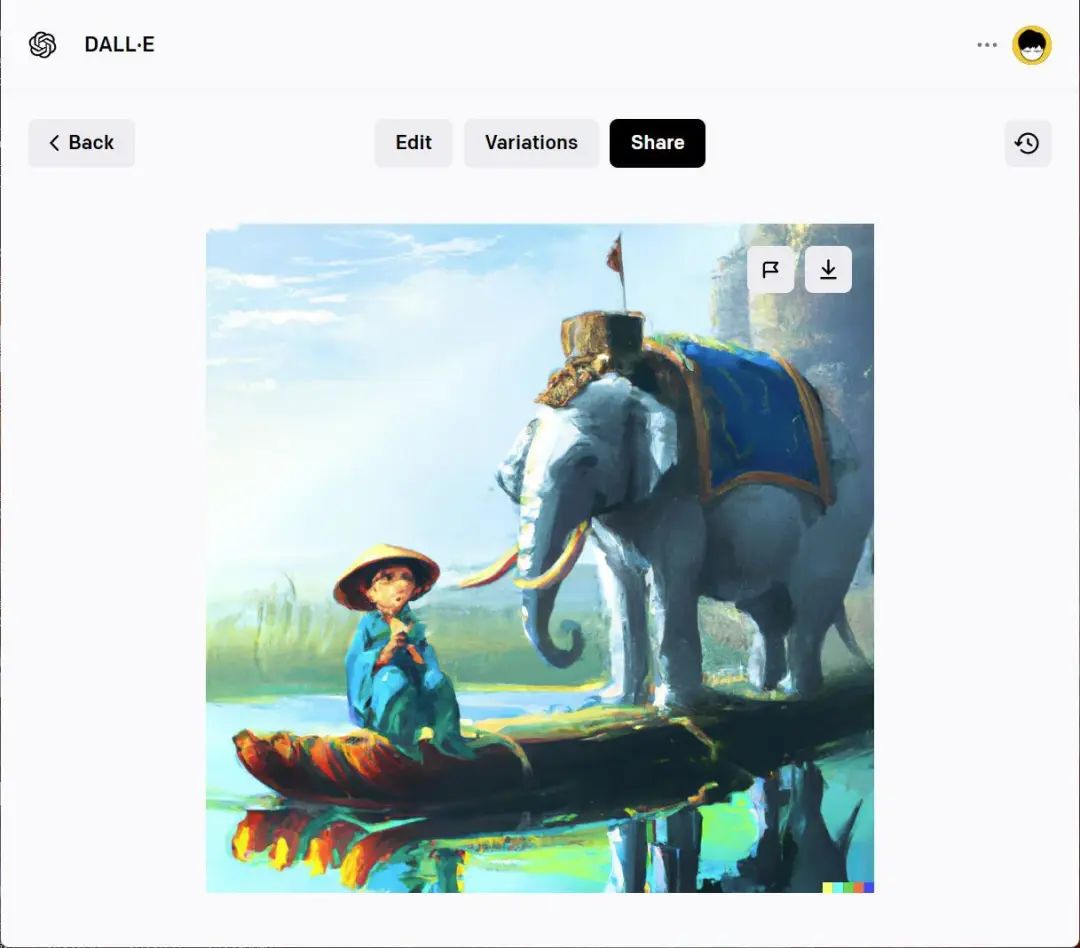

神说:“要有 Wi-Fi”丨做者用 DALL·E 2 生成

而后,OpenAI 的 DALL·E 2 中途杀出,和前两者擅长“观念画风”差异,DALL·E 2 更“写真”,60 秒不到可以生成 10 张图,不折意还可以擦去部分重重生成……短短几多个月,“最强 AI 画师”的称号几屡次易主。

谷歌也坐不住,五月底发论文引见自家选手——Imagen,间接叫板 DALL·E 2,号称 Imagen 有“史无前例的写真感和深度的语言了解”,目前久未开放。

那两个月来,我和前面三位“AI 画师”频繁打交道,的确每天都正在测试形容词、调教呆板人,踩了不少坑,翻了许多车。但取此同时,我支成为了许多杰做。

此次,我将对照它们的画做生成特点、用户友好度等方面,同时整理好了它们的网址,以及一些简略的收配办法。

正在普通用户这里,它们是具像化想象的得力工具;正在专业人群这里,假如将它们和其余工具联动起来,能有无穷尽的想象空间。

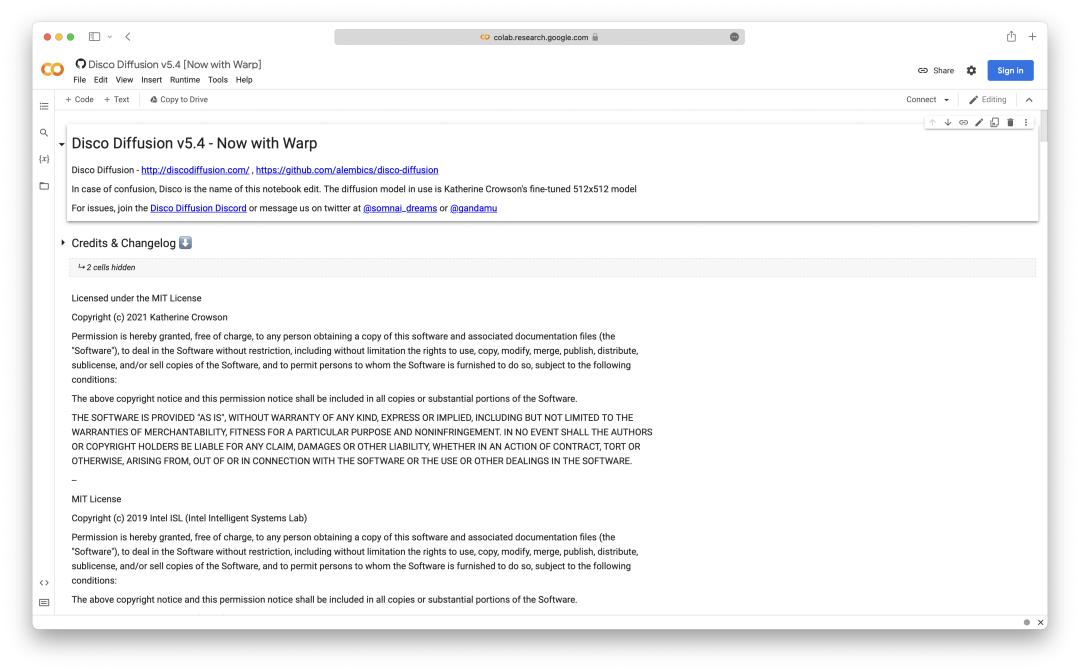

Disco Diffusion

生成图的艺术性最高

运用入口:hts://colab.research.googless/github/alembics/disco-diffusion/blob/main/Disco_Diffusion.ipynb

Disco Diffusion 生成画做的流程粗略分为那几多步:翻开步调;设置图片尺寸、历程图张数、生成图张数等参数;用英文写好形容词(Prompts),格局大抵为“画做类型 + 对象(可以有多个)+ 画风设定 + 一些起限定做用的修辞词”;而后初步运止,等候 AI 衬着画做。

我给 AI 写的形容词:“A beautiful painting of a starry night, shining its light across a sunflower sea by James Gurney, Trending on artstation.”

正常来说,你须要等半个小时,假如盯着屏幕看,你会看到图像从满是噪点,逐突变得明晰、有细节起来。

运用期间,Disco Diffusion 可能会提示你正在电脑上空出足够的运止内存,但因为它运止正在谷歌免费供给的 GPU 等计较资源上,对用户的电脑硬件要求其真不高,翻开阅读器运止就可以。

用 AI 画一个莫比斯格调的场景:“a beautiful painting of a spaceship flying oZZZer a desert by Moebius, trending on artstation.”

Disco Diffusion 自身是个免费的开源软件,但假如你想要更快的出图速度,可以买谷歌 Colab 会员,以分配到更快的云端计较资源。

除了只输入笔朱让 AI 自由阐扬,你还可以事先垫进一张初始化图片(Initial Image)去约束 AI 的创做。

比如,我先作了一张有树木皮相和绿涩涩块的底图(右),而后再收配,Disco Diffusion 就会正在那个大框架下去阐扬,成品为左图

Disco Diffusion 生成图真践上可以商用,其步调基于 MIT 开源和谈,所有互联网用户可免得费运用、复制、批改以至发售生成图。但我感觉还是存有风险。风险次要起源于你的形容词会引来画风抄袭的争议。

当你运用了格调明显的艺术家(特别是活着的艺术家),以及某部商业做品做为要害词时,都请不要间接拿来商用。

Midjourney

不怎样“超纲”,更“听话”

Midjourney 目前还是邀请制,内测地址:hts://o9q981dirmk.typeformss/to/zZtF1mxc?typeform-source=midjourney-gallery

为了测试 Midjourney 的生罪成效,我复制了之前“投喂”给 Disco Diffusion 的要害词——“星空”、“向日葵”、“梵高”——粘贴进去。

我用 Midjourney 生成的画

看到成品,我有一个曲不雅观的感应:Midjourney 的想象力没有 Disco Diffusion 这么会“超纲”。但假如从帮助创做的角度思考,我会更倾向于用 Midjourney 那个更“听话的工具”,究竟,没有一个创做者甘愿承诺把创做主导权让给 AI。

Midjourney 的劣点便是:快。软件生成图很是快,一张算下来粗略 60 秒。你要是对成品不折意,还可以的确真时地提升细节,或延伸厘革。

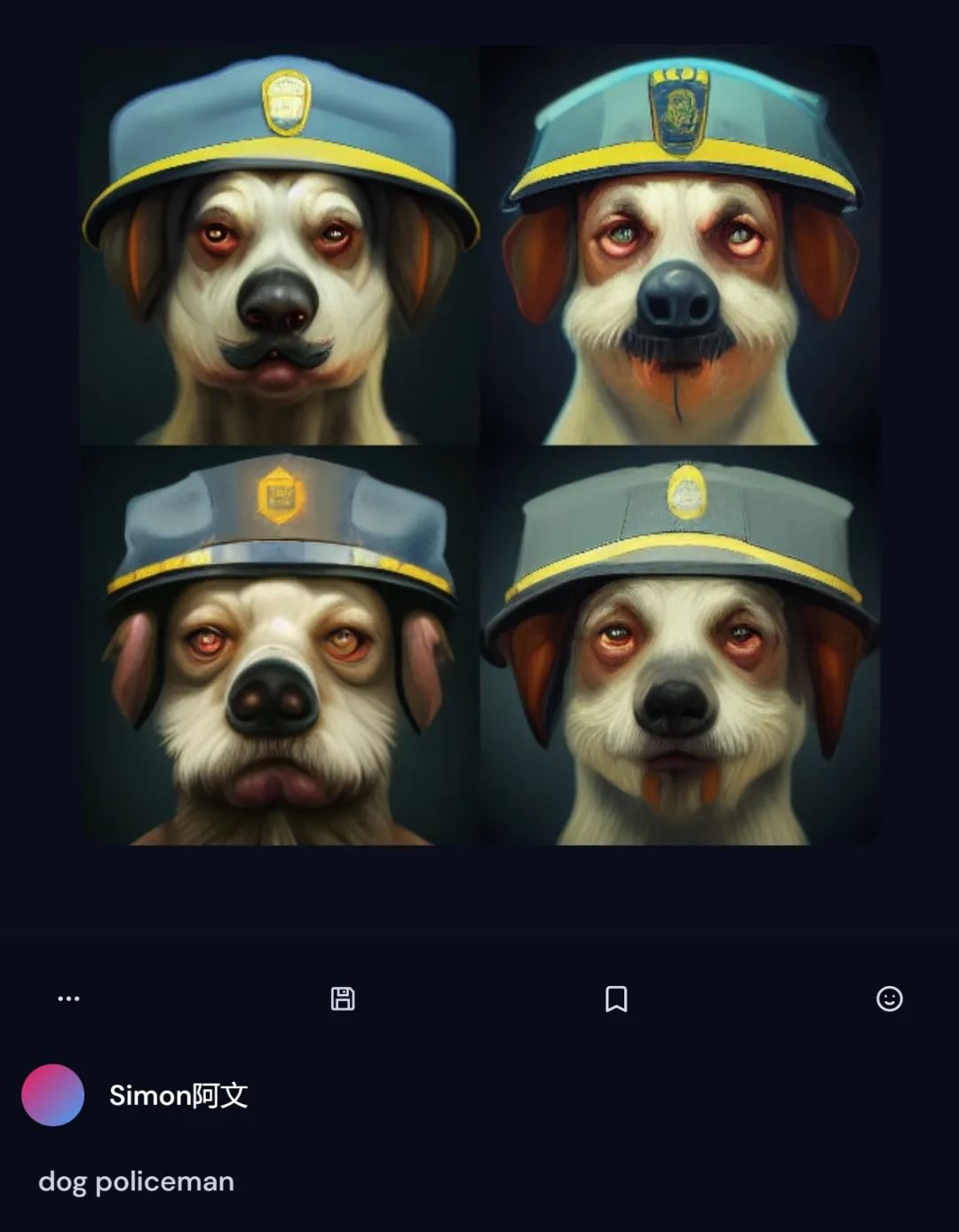

一分钟生成 4 个小狗差人丨用 Midjourney 生成

Midjourney 搭正在了通讯软件 Discord 上,正在对话框输入“/image”后,用英文输入形容词,而后按下回车键。那个历程就像正在和 AI 聊天一下。

60 秒后,你就可以正在对话框里支到 4 张衬着好的图片。假如对“图 1”不折意,可以点击“U1”按钮删多细节,按“x1”按钮延伸厘革,曲到折意为行。

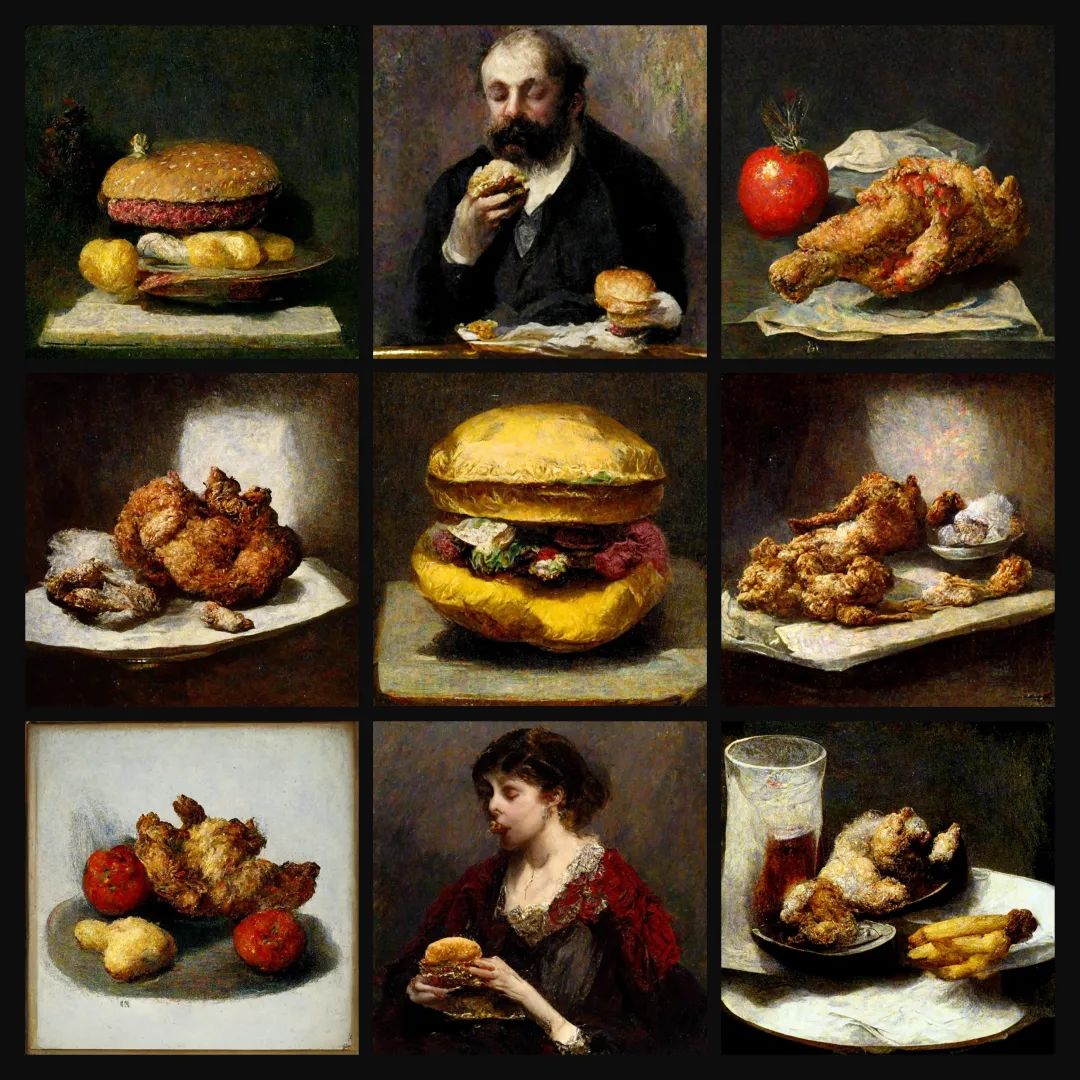

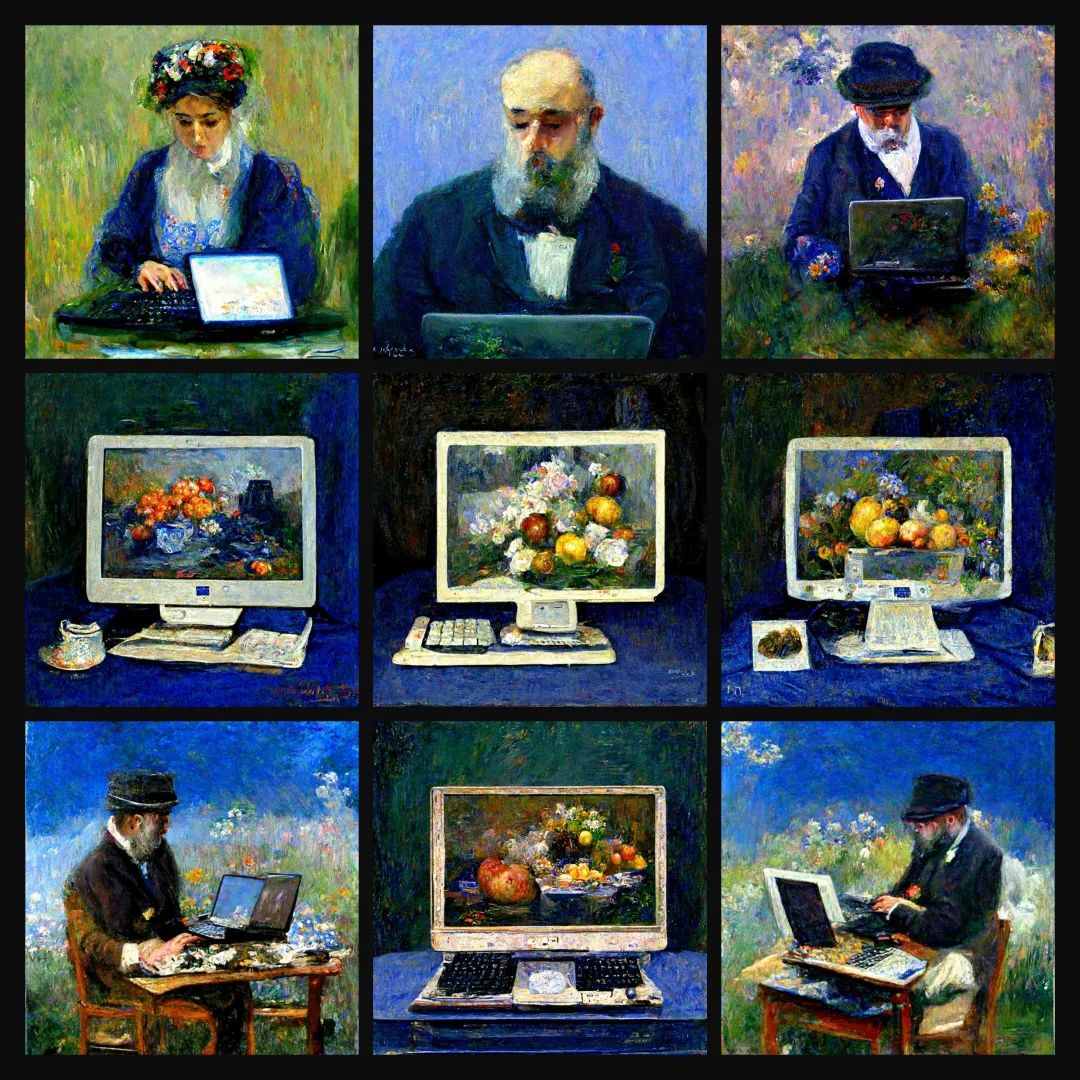

于是,我拿 Midjourney 生成为了“十九世纪的麦当劳”和“十八世纪的打工人”:

之所以说 Midjourney 是“产品化”了的 Disco Diffusion,一个是它的界面更友好,另一个是它还内建了一个创做社区,你可以看到玩家们用哪些形容词生成为了什么样的画做。那便是一个极具参考价值的“画风”数据库,太符折拿来“抄做业”了。

比如,我检验测验生成《爱,死亡和呆板人》里这集《糟糕之旅》的场景,参考了上图两位艺术家的形容词,之后就生成为了折意的画做:

“抄做业”让生成像样做品的门槛进一步降低了,但另一方面,也会失去了不少摸索的乐趣。不要让游戏秘籍誉掉了一个好游戏。

版权方面,假如你是免用度户,图像的版权归属于 AI,每月付出 30 美圆后,就能将图片拿去商用了。但同时,假如你因而赢利达两万美圆以上,则须要给 Midjourney 20% 的分红。

DALL·E 2

我给梵高理发,我让大象回身

我当了回“托尼”,用 DALL·E 2 给梵高理发,申请地址:labs.openaiss/waitlist

我等了一个多月,才拿到了 DALL·E 2 的内测资格。假如说 Disco Diffusion 更擅长描绘氛围、光景或观念艺术,这么 DALL· E 2 则擅长写真。

“大象能回身吗?”我以那个“规范甲方需求”为例,尝尝 DALL· E 2 的写真才华。

它转过来了。

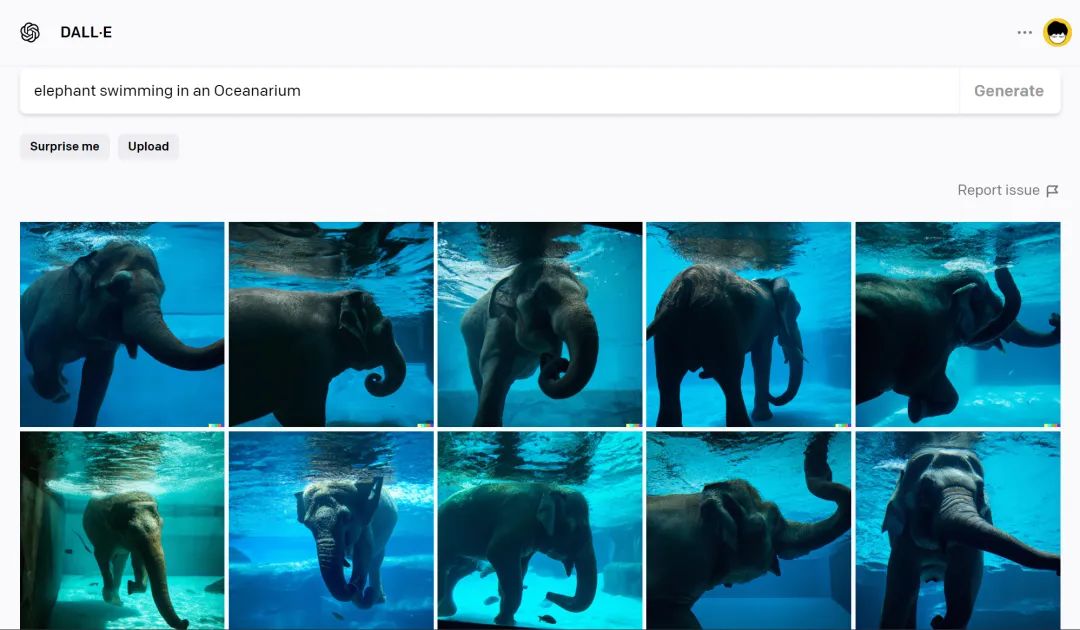

我让网友饰演甲方,让大象去作些其它工作。比如,让大象正在海洋馆里游:

让大象和鲨鱼共舞:

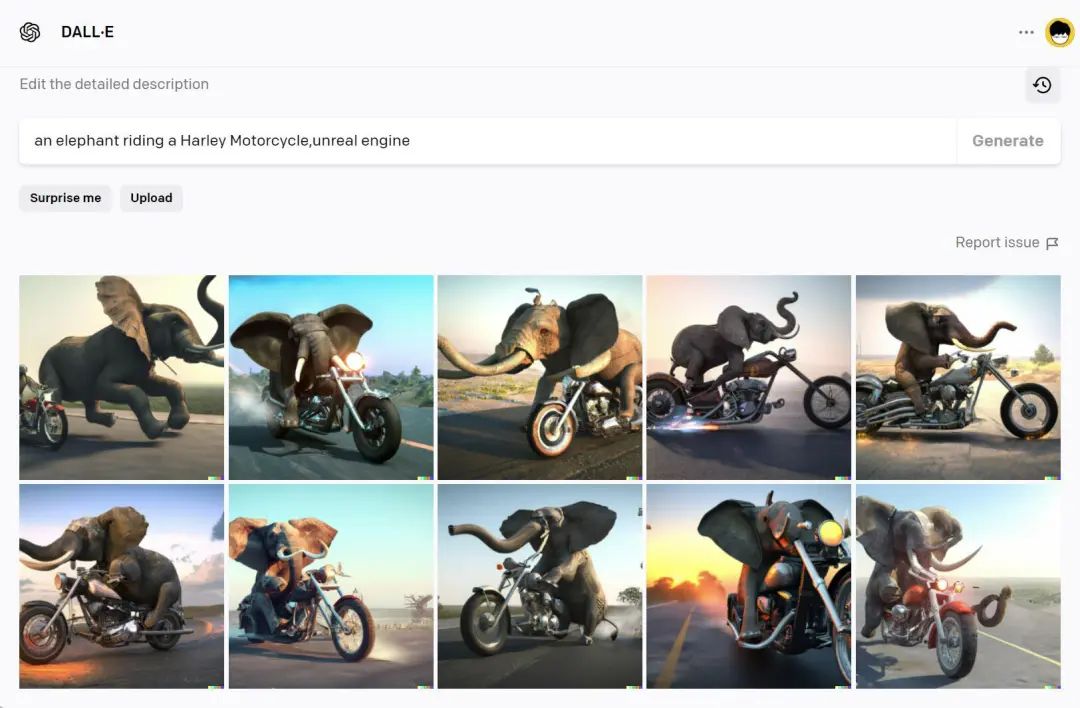

让大象开哈雷摩托车正在路上狂飙:

让大象被曹冲称:

“甲方”们无话可说。

毫不夸张地说,那是我目前用过体验最好的 AI 绘图工具,收配足够简略,完成度高,速度快到可以当搜寻引擎:不到一分钟生成 10 张图片(1024 × 1024),可无限延伸厘革,以至可以擦除部分重重生成。你可以不竭地给梵高“理发”。

正在版权方面,DALL·E 2 暗地里的组织 OpenAI 列了几多条严格的限制:图片生成版权最末归属 OpenAI;仅供个人进修摸索运用,不能商用,不能用于制做 NFT;不能正在社交媒体上发布过于写真的人脸生成结果,会有肖像侵权风险。

OpenAI 也传布鼓舞宣传曾经制行 AI 记与名人的脸,也避让了种族和性其它刻板印象等。

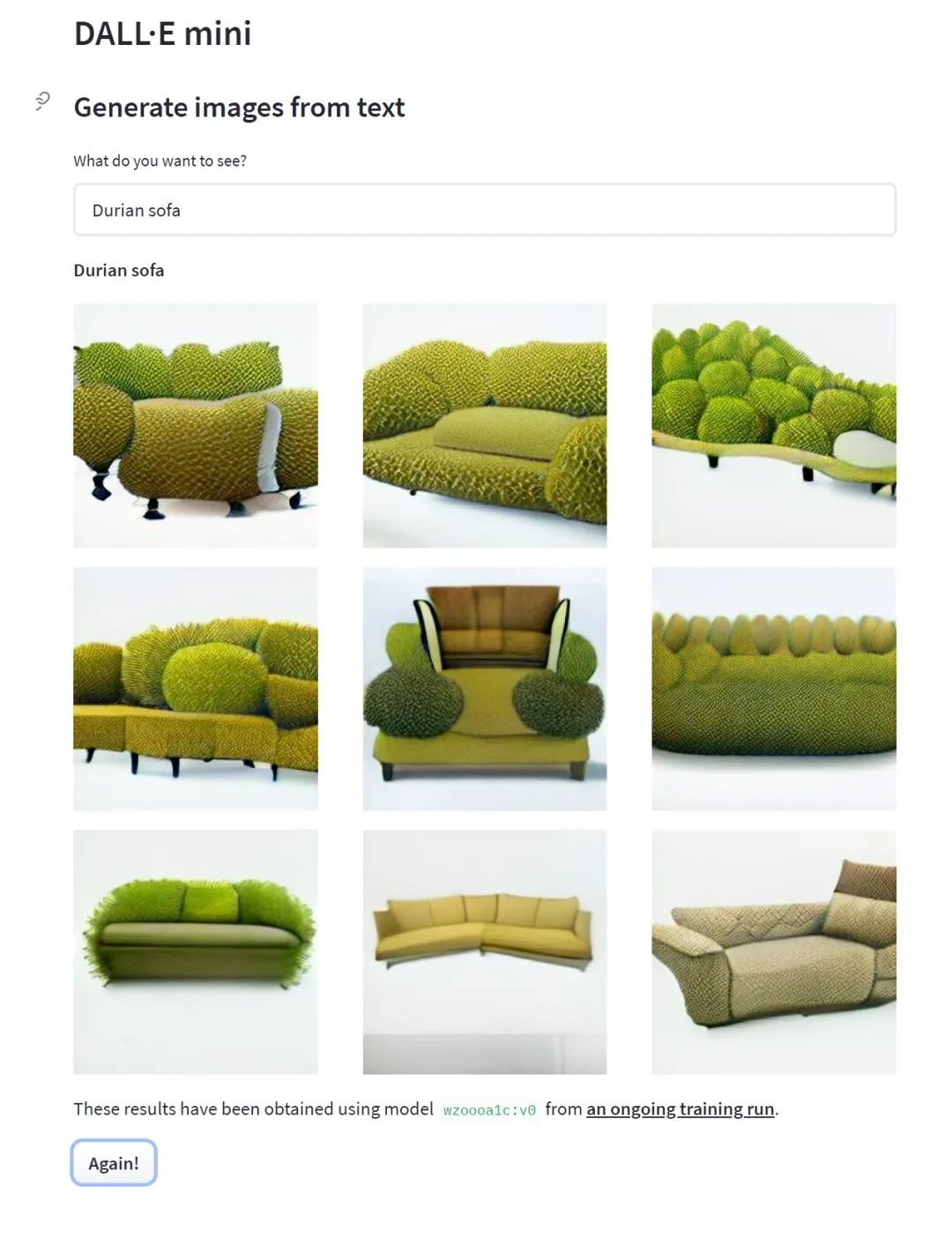

正在苦苦等到 DALL·E 2 内测资格之前,我找了一个“平替”——DALL·E mini,是用第一代 DALL·E 作的 demo,生成速度快,但画面完成度不及 DALL·E 2。

榴莲沙发|用 DALL·E mini 生成,软件地址:hts://huggingface.co/spaces/dalle-mini/dalle-mini

生成图像,只是第一步

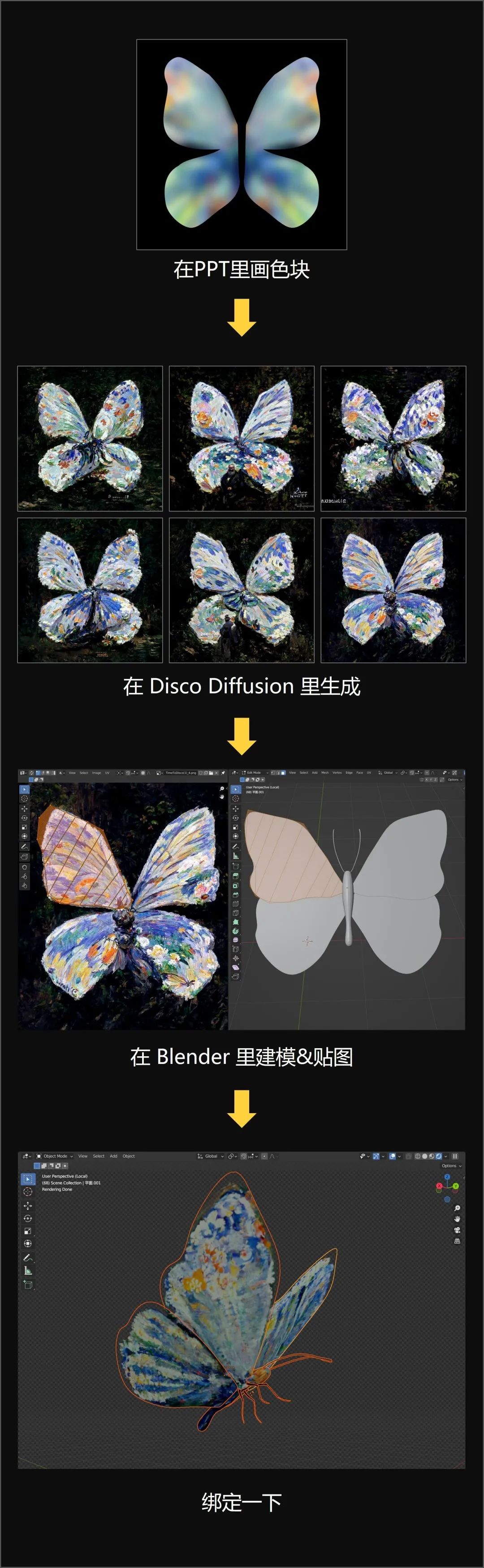

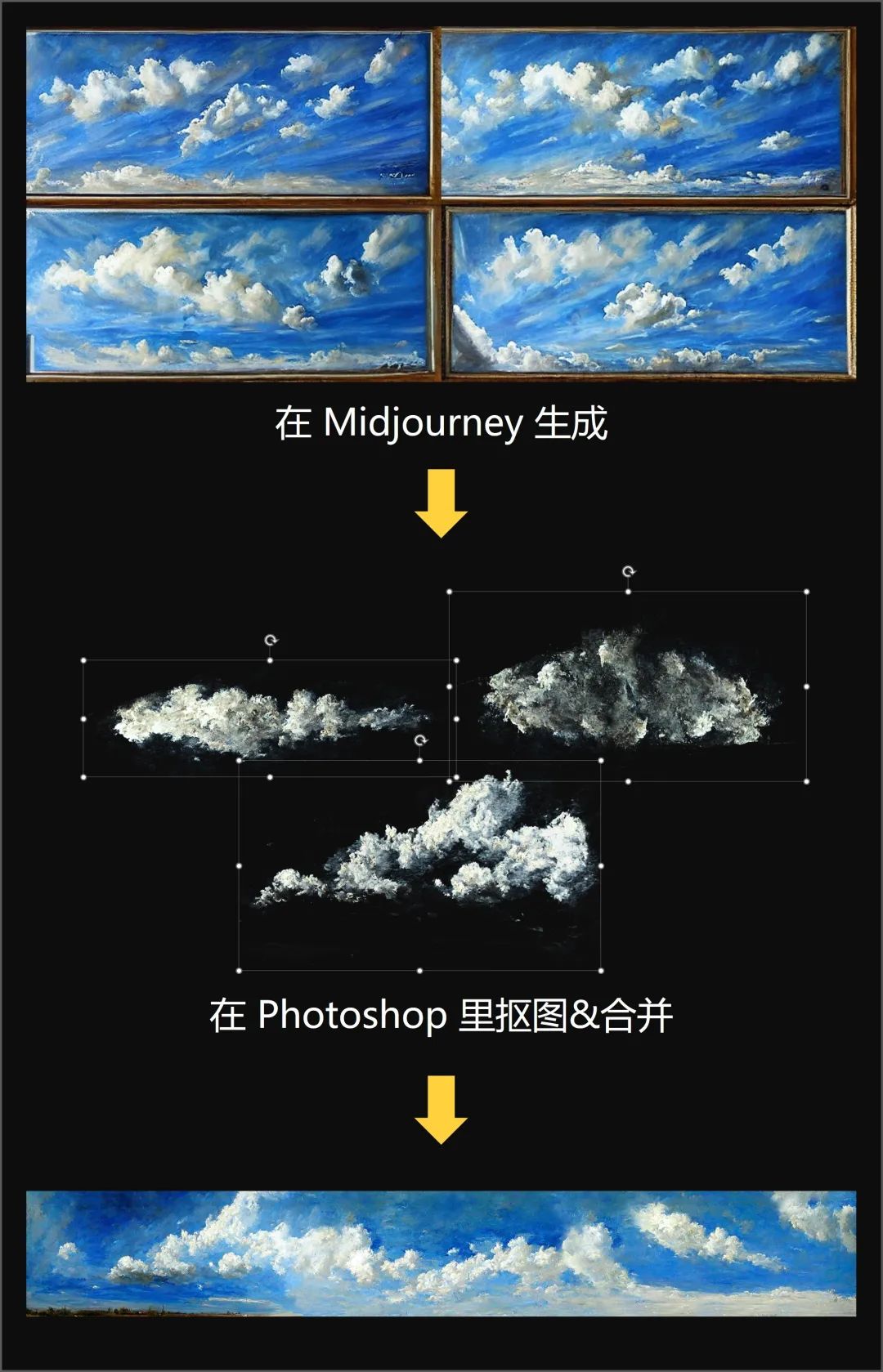

“能不能让它们动起来?”我看着 AI 返回来离去的画做,初步想法子:

AI 生成图像完成,其真不代表创意就完毕了。假如你把它当成此中一个环节,再连贯其余创意流程,想象空间是弘大的。

我再展示一下插画师 Nerko 的创意:他先用 Midjourney 生资原人想要的素材,而后再将那些部分组拆起来。

@NekroXIII

正在他手里,AI 是种“消费劲”。筛选和分解,仍是他全权主导。正在用上 Midjourney 之前,他曾经画了 15 年插画。